隨著電子商務的蓬勃發展和用戶數據量的指數級增長,傳統的推薦算法已難以滿足個性化、精準化的需求。將基于深度學習的商品推薦系統集成到以Linux為核心的企業級信息系統中,已成為提升商業智能與用戶體驗的關鍵路徑。

一、 深度學習推薦系統的核心優勢

基于深度學習的推薦系統,如深度協同過濾(DeepCoFi)、神經協同過濾(NMF)以及融合多模態信息(圖像、文本、序列)的復雜模型,能夠自動學習用戶與商品之間的深層次、非線性關系。相比基于規則或傳統機器學習(如矩陣分解)的方法,其優勢在于:

- 強大的表征能力:深度神經網絡能夠從原始數據(如用戶點擊序列、商品描述、評論)中自動提取高層次特征,減少對人工特征工程的依賴。

- 靈活的模型結構:可以輕松整合多種異構數據源,例如利用卷積神經網絡(CNN)處理商品圖片,利用循環神經網絡(RNN)或Transformer處理用戶行為序列,實現多維度推薦。

- 更高的精準度:在處理稀疏數據、挖掘長尾商品、實現實時動態推薦方面表現更優,顯著提升點擊率(CTR)和轉化率。

二、 Linux平臺作為集成基礎的優勢

Linux操作系統以其開源、穩定、安全和高性能的特性,成為部署企業級推薦系統的理想基石:

- 高性能與穩定性:Linux內核高效管理計算資源,能夠穩定支撐推薦模型7x24小時的高并發訓練與在線推理服務,尤其適合使用Docker/Kubernetes進行容器化部署。

- 豐富的開源生態:Linux上擁有成熟的大數據和AI技術棧,如用于數據存儲與處理的Hadoop/Spark,用于模型訓練與服務的TensorFlow、PyTorch、ONNX Runtime等,集成成本低。

- 安全與可控:開源特性允許深度定制和審計,符合企業對數據安全和系統可控性的嚴格要求。

三、 信息系統集成服務的關鍵環節

將深度學習推薦系統成功集成到現有Linux企業信息環境中,是一項系統工程,需涵蓋以下服務環節:

1. 數據管道集成與治理

- 對接企業已有的業務數據庫(如MySQL、PostgreSQL)、日志系統、數據倉庫(如ClickHouse)等,在Linux服務器上構建實時(Kafka/Flink)與批處理(Spark)相結合的數據流水線。

- 確保數據質量,進行用戶行為數據、商品元數據、上下文數據的清洗、歸一化和統一ID映射。

2. 模型開發與訓練平臺搭建

- 在Linux集群上搭建分布式訓練環境(如使用Kubeflow、MLflow進行生命周期管理),利用多GPU/CPU節點加速深度學習模型的迭代訓練。

- 實現模型版本的自動化管理與A/B測試框架,便于評估不同模型在線上的表現。

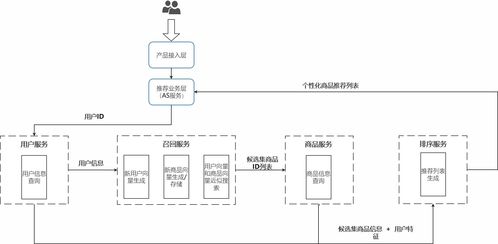

3. 在線服務與API集成

- 將訓練好的模型通過高性能推理服務(如TensorFlow Serving、TorchServe或Triton Inference Server)進行部署,封裝為RESTful或gRPC API。

- 在Linux反向代理(如Nginx)和API網關(如Kong)后部署這些服務,實現負載均衡、流量控制和與前端應用(Web/APP)及后臺管理系統的無縫對接。

4. 系統監控與運維保障

- 集成全方位的監控體系,包括:

- 基礎設施監控:利用Prometheus+Grafana監控Linux服務器的CPU、內存、GPU、網絡及存儲狀態。

- 服務與業務監控:監控推薦API的響應延遲、吞吐量、錯誤率及關鍵業務指標(如推薦結果的點擊率、轉化率)。

- 模型性能監控:持續追蹤模型預測效果,設置數據漂移和模型性能下降的告警機制。

- 建立自動化運維流程,實現模型的熱更新、服務擴縮容和故障自愈。

四、 實踐挑戰與應對策略

- 挑戰一:計算資源需求大。深度學習模型訓練消耗大量算力。

策略:采用混合云架構,在Linux環境中利用Kubernetes彈性調度本地與云上GPU資源;使用模型壓縮(如剪枝、量化)和高效推理框架優化部署成本。

- 挑戰二:系統復雜度高。從數據到服務的鏈路長,技術棧多樣。

策略:采用微服務架構,通過CI/CD流水線(如Jenkins/GitLab CI)實現自動化集成與部署,并使用服務網格(如Istio)加強服務治理。

- 挑戰三:實時性要求。需要近實時地根據最新用戶行為更新推薦結果。

策略:構建流式處理管道,利用Flink等流計算框架實時更新用戶特征向量,并結合高效的近似最近鄰(ANN)檢索庫(如Faiss)進行毫秒級召回。

五、 與展望

在Linux平臺上集成基于深度學習的商品推薦系統,是一項融合了數據科學、軟件工程和運維技術的綜合性服務。成功的集成不僅能顯著提升推薦效果和商業價值,更能構建一個靈活、可擴展、高性能的智能決策中樞。隨著大模型、強化學習等技術的發展,推薦系統將更加智能化和自主化,而穩定可靠的Linux開源生態將繼續為這類復雜信息系統的集成與進化提供堅實基礎。